Informática

Historia de la Informática

HISTORIA DE LA INFORMATICA

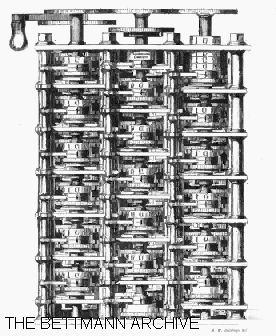

Máquina diferencial de Babbage

Considerada por muchos como predecesora directa de los modernos dispositivos de cálculo, la máquina diferencial era capaz de calcular tablas matemáticas. Este corte transversal muestra una pequeña parte de la ingeniosa máquina diseñada por el matemático británico Charles Babbage en la década de 1820. Si hubiera contado con la financiación adecuada, la idea que Babbage tuvo más tarde de construir la máquina analítica, hubiese llegado a ser una auténtica computadora programable. Las circunstancias quisieron que ninguna de las máquinas pudieran construirse durante su vida, aunque esta posibilidad estaba dentro de la capacidad tecnológica de la época. En 1991, un equipo del Museo de las Ciencias de Londres consiguió construir una máquina diferencial Nº 2 totalmente funcional, siguiendo los dibujos y especificaciones de Babbage.

LA HISTORIA DE LA INFORMATICA

1.-SOPORTE FISICO : HARDWARE

Los pioneros

Al tiempo que se empiezan a construir máquinas para la gestión de la información contable, los hombres de ciencia quieren una máquina de tratamiento automático de datos científicos, un calculador científico. Desde el punto de vista de la ingeniería parece un objetivo más difícil, por la amplia gama de matices de la información a tratar en el mundo científico en relación al mundo administrativo y comercial; sin embargo, existe la gran ventaja de poder estandarizar con facilidad los problemas científicos en un lenguaje formal, como es el lenguaje matemático.

La posibilidad de optar entre dos vías de actuación, o lo que es igual, de tomar y ejecutar una decisión se pudo implementar en los sistemas mecánicos primero mediante el concurso de la electricidad y, posteriormente, gracias al desarrollo de la tecnología, mediante la electrónica, pero en cualquier caso sobre la estructura tecnológica descansa una arquitectura lógica y matemática.

Un relé clásico es el órgano elemental del razonamiento automatizado, en cuanto que puede adoptar dos posiciones: sí o no, verdadero o falso, cero o uno, según un convenio de transcripción de información previamente establecido; en el tema siguiente se verá cómo un número de relés suficientemente alto, convenientemente reunidos en serie (la salida de uno convertida en entrada del siguiente), o en paralelo (salidas paralelas y entradas paralelas), o en montaje híbrido (serie, paralelo) van a producir circuitos lógicos.

Una vez que se logró simular físicamente un razonamiento lógico, todo el resto del desarrollo histórico del ordenador hasta hoy va a consistir en sustituir la tecnología primitiva de relés por tecnologías más avanzadas como válvulas de vacío, distintos tipos de transistores, circuitos integrados, etc. Conviene citar los trabajos de Shannon, entre una pléyade de científicos, matemáticos e ingenieros, como esenciales para lograr la conexión entre los aspectos físicos y los fundamentos lógicos que tienen lugar en un ordenador.

En 1937 Howard Aiken, físico de la Universidad de Harvard, diseñó los planos para una máquina que obedecía órdenes consecutivas; dicha máquina fue construida por IBM y donada en 1944 a la Universidad de Harvard; se le llamó MARK I y fue la calculadora más potente con piezas electromecánicas.

Ya se ha mencionado, en la introducción a este capítulo, que ENIAC fue el primer ordenador electrónico en el que el proceso de datos y su almacenamiento y el control de las operaciones se realizaba por medio de dispositivos electrónicos, los tubos de vacío, que hacen posible el salto del cálculo eléctrico al electrónico.

En 1945, Von Neumann proponía diseñar y construir un ordenador que trabajase en sistema binario, capaz de almacenar en su interior los datos necesarios para la resolución del problema que se le plantease y con una memoria de mucha mayor capacidad que las conseguidas hasta ese momento.

En 1949 se construía en la Universidad de Cambridge, en Inglaterra, el primer ordenador comercial destinado a la gestión; era un ordenador decimal que permitía utilizar caracteres alfabéticos, la entrada y salida de datos se realizaba por medio de tarjetas perforadas y utilizaba unidades de cinta magnética como memoria auxiliar.

Generalidades en la historia de los ordenadores

La base fundamental de la evolución de los ordenadores digitales ha sido el desarrollo de los componentes que forman su memoria y unidades de cálculo.

Los ordenadores digitales, que son normalmente de uso general, trabajan directamente con los datos numéricos, representándolos por medidas de variables discretas, como son los impulsos eléctricos, los dientes de una rueda dentada, etc.

Los ordenadores analógicos, dedicados a problemas específicos, trabajan con los números, transformándolos mediante escalas en medidas de variables continuas, como son longitudes, corrientes, fuerzas magnéticas, etc.

Para aprovechar la rapidez del ordenador analógico y la precisión del digital, según los cálculos requieran una u otra característica, se han construido ordenadores «híbridos» de los dos tipos anteriores.

Con este criterio se habla de cinco generaciones, hasta el momento presente, en la historia del ordenador.

-Primera generación: se la suele situar cronológicamente entre 1950 y 1960. Es la etapa de las empresas iniciales del mundo informático, Remington Road (UNIVAC) e IBM, que no venden sino que alquilan los ordenadores, tales son los elevados costes que comportan. Es la generación de las válvulas de vacío, con un soporte de programas muy rudimentarios escritos en código máquina.

-Segunda generación: la invención del transistor por W. Shockley va a marcar la diferencia con la primera generación; a principios de 1960 salen al mercado los primeros ordenadores transistorizados. En esta generación, que cubre de 1960 a 1964, además de la sustitución de las válvulas de vacío por transistores, tiene lugar la ampliación de las memorias internas, la generalización del concepto de arquitectura modificable, se usan periféricos de gran masa de memoria como los tambores y discos magnéticos y se reduce el tamaño de los ordenadores. Aparecen los lenguajes ensambladores que traducen las instrucciones del código máquina, llegando a generar ya lenguajes de alto nivel como FORTRAN, COBOL y ALGOL.

-Tercera generación: abarca aproximadamente la década 1964-1974; se progresa considerablemente en la reducción de tamaño y aumento de la velocidad de cálculo, mediante la implementación de diferentes tecnologías de integración de transistores y otros circuitos de estado sólido. Se avanza mucho en software, desarrollando más lenguajes de alto nivel (PL1, BASIC, RPG, APL) y sistemas operativos, se inicia la programación estructurada, se construyen potentes compiladores e intérpretes, se generaliza el uso en las empresas de paquetes de software, bibliotecas de programas y bases de datos; aparecen las técnicas de tiempo compartido y la multiprogramación. Se generalizan los periféricos en la arquitectura de los ordenadores, dotando a los sistemas informáticos de una gran modularidad; se hace uso del teleproceso, de discos flexibles y de lectoras ópticas.

En este momento es cuando se estructura el mercado de ordenadores constituyéndose las compañías que llegan hasta nuestros días: IBM, Control Data, Nixdorf, Philips, ICL, Bull, Bourroughs (hoy Unisys), NCR, Siemens, Fujitsu, etc.

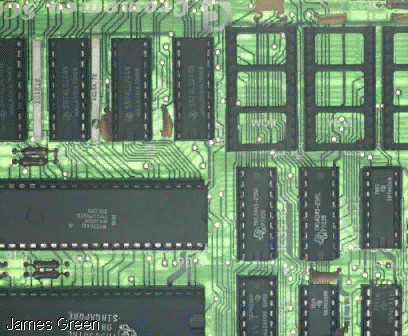

-Cuarta generación: mediante las técnicas de integración a gran escala se produce la revolución del microprocesador; el tamaño de los ordenadores se reduce a una décima parte con respecto a los de la anterior generación, se alcanzan velocidades multiplicadas por factores de 10, 50 y hasta 100, y se llegan a grandes masas de memoria en reducidísimos tamaños; todo ello gracias a la tecnología LSI (gran escala de integración).

En Silicon Valley, INTEL Corporation produce el primer microprocesador, es decir, un «chip», una pieza única de tamaño muy reducido que contiene miles de componentes electrónicos y que pueden realizar cualquier tarea lógica constituyéndose en la unidad central de proceso de un ordenador; inmediatamente después salen al mercado los microprocesadores Z-80, 6800 de Motorola y otros.

Basándose en los microprocesadores, aparecieron los ordenadores de uso personal: en el número de enero de 1975 de la revista «Popular Electronics» aparecía la descripción de un ordenador que podía comprarse sin armar por 395 $ o que podía obtenerse armado por 650 $; se llamaba «Altair 8800» y estaba basado en el microprocesador 8080 fabricado por la empresa Intel. Su diseñador y constructor era Edward Roberts que fundó una pequeña compañía instalada en un garaje de una casa de Alburquerque, Nuevo México. Roberts se quedó sorprendido del éxito pues sólo esperaba vender unos cientos de Altair y recibió miles de peticiones que no podía atender.

Otro éxito espectacular en la historia de los negocios en los EE.UU. es la empresa Apple. Poco después de la aparición de Altair dos amigos apasionados por la electrónica, Stephen Wozniak y Steven Jobs, de 25 y 20 años respectivamente, fundaban Apple Computers Company con el exiguo presupuesto que provenía de la venta de un coche y de una calculadora programable y de un pequeño crédito; fabricaron un ordenador del que vendieron unas 175 unidades a unos 500 $ cada una, a pesar de que era un aparato de muy difícil uso pues no tenía teclado ni terminales. En 1977 lanzaron el modelo Apple II que constituyó un rotundo éxito; a finales de 1983 alcanzaron un volumen de ventas de mil millones de dólares.

En 1981, IBM lanzaba con mucho retraso y mucha cautela, un ordenador personal, el PC (Personal Computer), del cual ese año vendieron ya 35 000 unidades y en 1983, 800 000, situándose en el primer lugar de las ventas de microordenadores para empresa.

En estos últimos años han aparecido continuamente nuevas máquinas y casi todas las grandes empresas de material electrónico, material de oficina o calculadoras, americanas, europeas o japonesas están tratando de hacerse un hueco en este floreciente pero difícil mercado (muchas empresas de Silicon Valley y otros parques tecnológicos han quebrado por la dura competencia en el sector de las tecnologías de vanguardia).

Al mismo tiempo que se producía este gran desarrollo de los PC's, se profundizaba en la investigación de los grandes ordenadores y de los superordenadores, como el CRAY-1, diseñado por Seymour R. Cray, que tiene una memoria interna superior a los 8 megabytes y realiza 200 . 106 operaciones por segundo; el CRAY llega a manejar en ampliaciones de memoria hasta 20 gigabytes. Otros superordenadores son el FALCOM, japonés y el Numerical Aerodinamic Simulation Facility.

-Quinta generación: hoy día existen múltiples proyectos de investigación y experiencias ya realizadas o en curso de realización en el terreno de la Inteligencia Artificial (IA) y de los Sistemas Expertos, temas que se tratarán en un capítulo posterior.

2.- SOPORTE LOGICO : SISTEMA OPERATIVO.

Un ordenador es, como ya hemos visto, una máquina que se dedica a «ejecutar programas». Pero hay muchas cosas que debemos decirle al ordenador, además de cuál es el programa que queremos ejecutar: con qué nombre se conoce el programa que nos interesa, cómo hay que organizar la memoria, donde están los ficheros que nuestro programa necesitará, dónde ha de guardar los que querremos grabar, etc. Todo esto y mucho más es necesario para hacer funcionar correctamente el ordenador.

Evidentemente, no sería práctico que el operador tuviese que dar, de la manera que fuese, todas las instrucciones cada vez. De manera que hay que buscar algún procedimiento que haga de intermediario entre el operador y el hardware. Se podrían incluir todas estas funciones dentro de cada uno de los programas (de hecho, en los ordenadores más primitivos se incluían), pero es evidente que un conjunto tan amplio y tan complejo no puede estar dentro de cada programa sin que el resultado sea necesariamente poco ágil. Además, esto exigiría que las instrucciones de cada uno de los posibles programas fueran compatibles, y haría prácticamente imposible que el ordenador pudiera ejecutar más de un programa a la vez, como hoy es habitual. Por todo esto y muchas otras razones, pronto se vio que era mucho mejor que hubiera un programa (un conjunto de programas en realidad) que hiciera todas estas funciones comunes. Esto es precisamente lo que se llama sistema operativo.

El sistema operativo de un ordenador es, pues, un conjunto de programas que tienen el objetivo básico de ampliar el potencial y la utilidad global del sistema, completando el hardware disponible con ciertas funciones nuevas o más potentes, como por ejemplo la carga y descarga automática de programas en función del espacio de memoria disponible, la gestión de los distintos periféricos, el control de la ejecución automática de los programas, con detección automática de determinados tipos de errores, el análisis de los recursos utilizados por los distintos programas, no sólo por motivos contables, sino también para facilitar su acceso bajo condiciones controladas, etc. El sistema operativo también mantiene la comunicación con el operador del sistema, tanto para tenerlo informado de los trabajos en curso como para pedir, si hace falta, su intervención.

3.- SOPORTE LÓGICO: SOFTWARE DE APLICACIÓN

SOFTWARE INTEGRADO

Concepto de software de base

En la práctica, los programas correspondientes a todos estos tipos de tarea han sido desarrollados separadamente (incluso por empresas diferentes). Así, la manera como cada programa guarda los datos en los ficheros puede ser, y de hecho es, muy diferente. Hasta el punto que, si tomamos dos aplicaciones al azar, es muy probable que no podamos hacer el traspaso de información de una a otra si, previamente, no hemos hecho algunas operaciones especiales. No obstante, la necesidad de realizar este traspaso ha cobrado importancia a medida que el uso en paralelo de los programas citados se ha ido demostrando imprescindible.

Concepto de paquete integrado

Este problema ha ido hallando solución por medio de la integración: la capacidad de las diversas aplicaciones de dialogar entre sí y compartir la información. Un método de integración consiste en la creación de estándares, que permitan acceder a ficheros grabados por otra aplicación (por ejemplo, los llamados ficheros ASCII); un paso adelante, en este sentido, lo ha dado la capacidad de ciertas aplicaciones de leer ficheros que tienen el formato específico de otra aplicación, mediante los oportunos programas de conversión. Muchas aplicaciones actuales ya han sido pensadas para ser utilizadas conjuntamente con otras relacionadas, y se diseñan de forma que los ficheros respectivos sean exportables entre ellas. Es el caso, por ejemplo, de Word, AmiPro con Lotus o Excel o DBase.

Pero no podemos hablar de verdadera integración hasta la aparición de los llamados paquetes integrados, es decir, piezas de software que contienen varias de las aplicaciones antes mencionadas, las más frecuentes para un usuario medio: el procesador de textos, la hoja de cálculo, la base de datos y los gráficos, reunidos en un mismo entorno de trabajo.

Paquetes integrados: ventajas

El uso de los paquetes integrados tiene ventajas evidentes: no solamente resuelve de manera automática el traspaso de información entre sistemas diversos, sino que ofrece al usuario la tranquilidad de trabajar en un ambiente estable. Esto significa que el usuario no ha de aprender el significado y funciones de cada tecla, y los mandatos específicos de cada programa, ya que el entorno de trabajo y las teclas funcionales soportan siempre las mismas funciones.

Existen en el mercado diversos paquetes de este tipo: por nombrar sólo los más conocidos, podemos citar: Open Acces, Symphony, Framework...

Informatica 3 - 14/07/

Descargar

| Enviado por: | Roman Crespo |

| Idioma: | castellano |

| País: | España |